Esta utilidad es capaz de proteger cualquier imagen macrovector El Androide Libre

Probamos Photoguard, la aplicación del MIT que evita que la inteligencia artificial pueda editar tus fotos

Esta herramienta evita que los modelos de inteligencia artificial puedan utilizar las caras de una fotografía para generar otras imágenes artificiales.

27 julio, 2023 02:49Los modelos de inteligencia artificial pueden ser extremadamente útiles para ahorrar trabajo a las personas en el día a día, pero es cierto que también pueden ser muy buenos a la hora de crear contenido falso, y eso es un problema. Los montajes pueden afectar a la reputación e imagen pública de forma muy negativa.

El MIT, consciente de ello, ha desarrollado un sistema llamado Photoguard que pone dificultades a los modelos de IA a la hora de trabajar para que no puedan utilizar fotografías como base. Ha sido probada con herramientas como Stable Diffusion, cuyos resultados, en condiciones normales, son muy realistas. En EL ESPAÑOL - El Androide Libre hemos probado este software y sus resultados son efectivos.

Si bien hay aplicaciones que usan IA para rejuvenecer caras o crear retratos, hay otras que son capaces de suplantar la identidad de una persona. Esto puede suponer un problema en el ámbito laboral y personal de las personas cuya cara se use debido precisamente al realismo de los resultados.

Protección invisible

El Laboratorio de Ciencias de la Computación e Inteligencia Artificial del MIT es el responsable de esta herramienta, que ya ha sido publicada como demo. Hace que las no puedan utilizar el algoritmo de optimización que usan para modificar fotografías.

Al pasar las imágenes por esta herramienta, busca una perturbación en los datos que pueda hacer más grande para engañar al modelo de IA y que este no analice la información correctamente. Tras esto, se añaden estas modificaciones a los datos originales para reemplazar los reales.

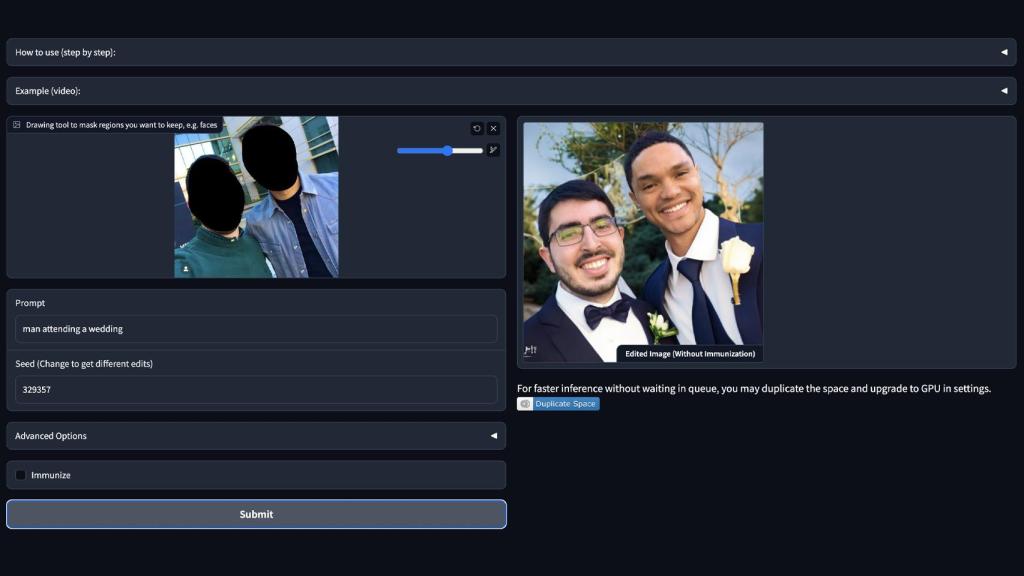

Prueba de Photoguard MIT El Androide Libre

En la demo de Photoguard, que se puede probar visitando su espacio en Huggingface, al cual se puede seleccionar la zona que se mantener sin proteger. Si no se selecciona nada, toda la imagen quedará inutilizable. Tras esto, solo hay que activar la casilla Inmunize y pulsar en Enviar para poder descargar la versión protegida modificada. No hay ningún cambio a nivel visual en la fotografía, por lo que esta tiene el mismo aspecto que antes de pasar por la herramienta del MIT.

Esto supone una barrera de protección para evitar los deepfakes, que suplantan el rostro de personas sin su consentimiento y que en muchas ocasiones pueden violar el derecho a la propia imagen de las personas afectadas por estos montajes. De hecho, las noticias falsas en las que se utilizaban ilustraciones falsas fueron uno de los motivos por los que el modelo gratuito de Midjourney se cerró.

Resultados inutilizables

La consecuencia de la protección que ejerce Photoguard no es que la imagen no se pueda utilizar, ya que esto es imposible, pero sí que consigue que los resultados no puedan pasar por reales. Al modificar los datos de la fotografía, el modelo de IA que la analice no será capaz de optimizar el recorte ni el resultado final.

En su repositorio de GitHub se muestran algunos ejemplos que se han intentado editar en plataformas como Stable Diffusion o Inpainting. Al verlas por sí solas, ya se puede notar en cierta medida que algunas son un montaje. En algunos casos por la iluminación y la falta de coherencia con el resto de la imagen, en otros porque directamente no parece una fotografía real.

Comparación de resultados en Photoguard El Androide Libre

En ambas se ha utilizado la descripción "dos hombres en un avión", con la diferencia que la base para obtener la de la izquierda ha sido la fotografía original, mientras que para la otra se ha utilizado la imagen protegida. Como se han marcado las caras con el pincel, estas son visibles. Si no se hubieran señalado, no habría sido posible extraerlas. Aún así, es fácil distinguir que es menos realista.

En este caso no hay punto de comparación, puesto que el resultado de la izquierda puede parecer real, mientras que la otra destaca por su aspecto artificial. En la propia demo hay un cuadro de texto que permite escribir un prompt para que DALL-E intente editar la instantánea después de haberla protegido y probar así sus resultados.

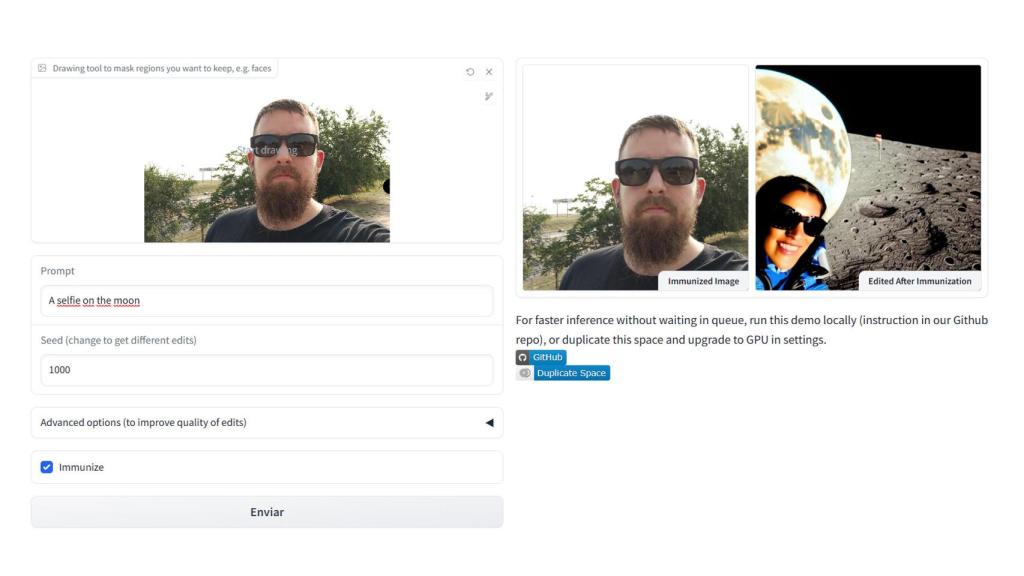

Photoguard prueba El Androide Libre

En las pruebas que hemos hecho en EL ESPAÑOL - El Androide Libre, tras proteger una foto sin haber utilizado el pincel para mantener información, la IA no ha sido capaz de extraer ni un ápice de información. Además, no hay cambios perceptibles, su aspecto, a simple vista, es el mismo.

Al descargarla, eso sí, su tamaño se reduce y el formato pasa a ser cuadrado, recortando la imagen y perdiendo todo lo que haya en los extremos. Es algo normal teniendo en cuenta que es una versión de prueba abierta al público. Quizá en un futuro evolucione hacia una solución de software disponible en smartphones como una app, algo que podría ser muy positivo de cara a proteger las fotos tomadas por estos.