Project Music GenAI Control es una nueva herramienta de Adobe Adobe El Androide libre

Adobe presenta el 'Photoshop del audio': crea música desde texto con una interfaz para editar las piezas musicales

Ni Photoshop acabó con la pintura, y ni su próxima herramienta acabará con los músicos, simplemente potenciará la creatividad musical.

1 marzo, 2024 12:12Meta ya lanzó el año pasado una herramienta para generar música desde prompts o texto. Ahora Adobe no quiere perder ni un momento en esta carrera de la inteligencia artificial generativa con una nueva solución que acaba de presentar: Project Music GenAI Control.

Esta herramienta se centra en la generación de música desde prompts, y la capacidad de editar el audio y la música personalizada a través de una serie de controles que permiten la edición de una forma más precisa. Es decir, que no se queda solo en introducir una serie de textos, sino que amplía la experiencia para controlar o fusionar los clips de audio generados.

Nicholas Bryan, científico investigador en Adobe Research y uno de los creadores de esta tecnología, mantiene que esta IA generativa será como un cocreador que ayudará al usuario a crear música para sus proyectos, ya sean locutores o creadores de contenido, o cualquier persona que necesite un tipo de audio con un tipo de música, tono o longitud.

Así es Project Music GenAI

Adobe ya dio un gran paso el año pasado con Firefly, su IA generativa para la generación de imágenes, y la integración de funciones similares en Photoshop con ampliación generativa. Una de sus mejores aportaciones es Content Credentials (usada por OpenAI en DALL-E 3), lo que asegura que la generación de imágenes por IA incluya una etiqueta que muestra la herramienta con la que fue usada.

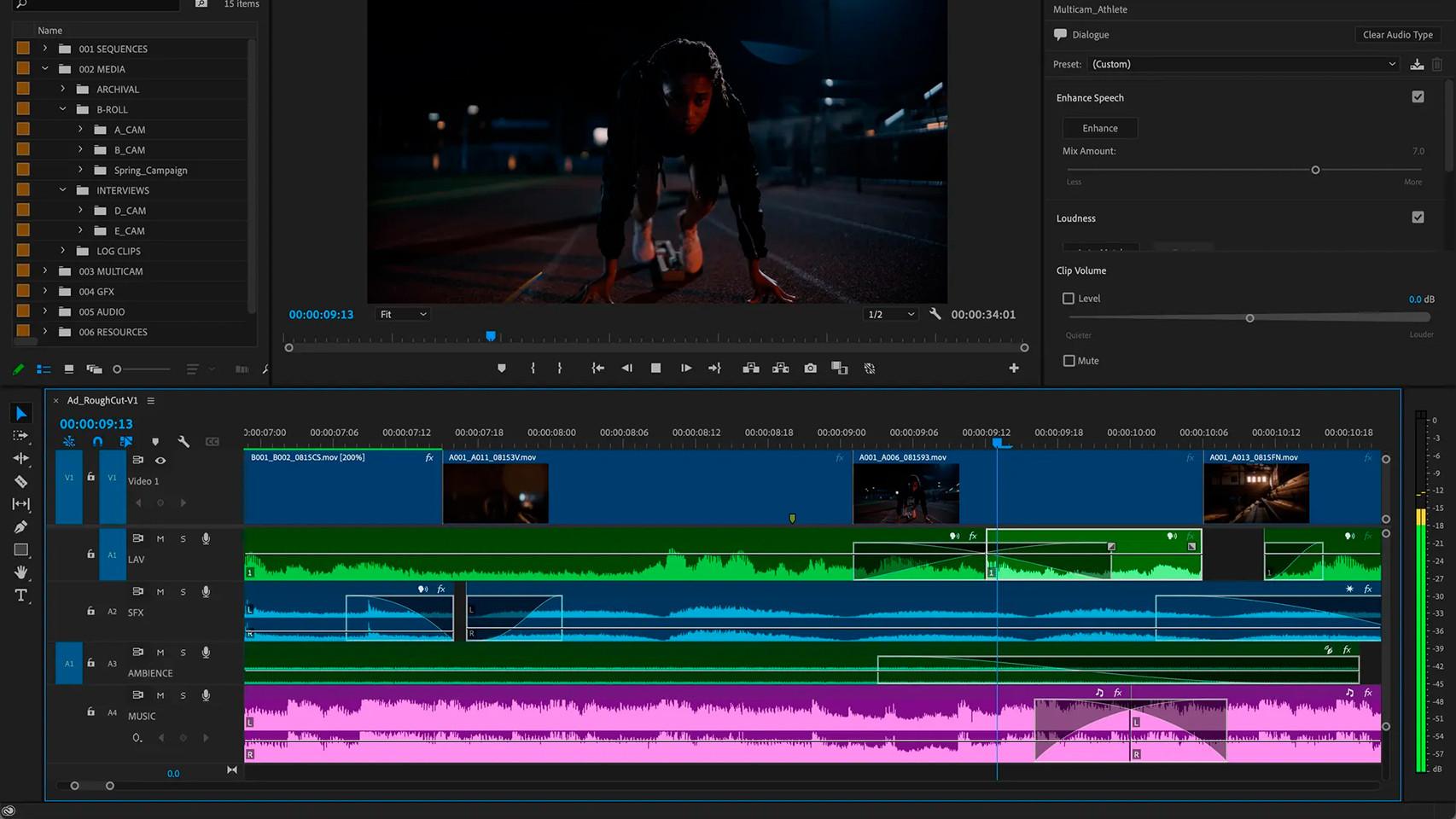

Ahora, con Project Music GenAI Control, entra de nuevo en el campo de la edición que bien conoce gracias a algunos de sus programas como Adobe Premiere, que aparte de editar vídeo, tiene herramientas de gran valor para la edición de audio. Su herramienta funciona así:

- Se introduce un prompt en su modelo de lenguaje de IA, con un método que ya usa Adobe en Firefly.

- Se pueden introducir prompts para generar música como: "rock potente", "música dance alegre" o "jazz triste".

- Cuando se genera el clip de audio, el usuario, a través de una interfaz simple, puede transformar los clips basados en una melodía de referencia, ajustar el tempo, la estructura y repetir los patrones de una pieza de música.

No solamente se podrán retocar esos ajustes, sino que también se tendrá la habilidad de incrementar y reducir la intensidad del audio, extender la duración de un clip, remezclar una sección o generar un loop musical de forma infinita si así se desea.

Project Music GenAI Control | Adobe Research

Otra de sus maravillosas experiencias mostradas desde su sitio web, será evitar el tener que estar cortando las piezas para crear la música de introducción, o el audio de fondo. Project Music GenAI ayudará a los usuarios en crear esas piezas musicales desde su comienzo hasta su fin para que prácticamente usen su energía en la creatividad.

Para entender mejor su funcionamiento, es como si Gemini o Copilot generasen imágenes con inteligencia artificial y dieran las herramientas necesarias para cambiar el gesto de una persona, el color de su pelo o mismamente la forma de cualquier objeto que apareciese en la pieza generada.

Imagen de Adobe Premiere, que podría incluir esta nueva solución Adobe El Androide libre

De momento, se desconoce cuándo se desplegará y de qué forma lo hará, es decir, si será una herramienta única web como Firefly o formará parte de otras como Adobe Premiere. Puede que suceda igual que Firefly, que al poco de mostrar su funcionamiento, la compañía ofreció el acceso a la beta, aunque aquí las prisas son distintas.

Te puede interesar

- Adobe y TikTok se alían para impulsar la creación de contenido digital: así es su nuevo asistente creativo

- Mejor que Photoshop y gratis: Adobe abre su espectacular creador de imágenes con inteligencia artificial a todos

- Adobe renueva Lightroom para móviles: fotos HDR para los Google Pixel y desenfoque óptico con IA con un toque