La automatización para las máquinas llegará más tarde que pronto, y lo más probable es que el campo militar sea de los primeros en aprovecharse de sus ventajas. Figuras destacadas dentro de este mundo ya se han pronunciado en contra, ¿pero de verdad importa?

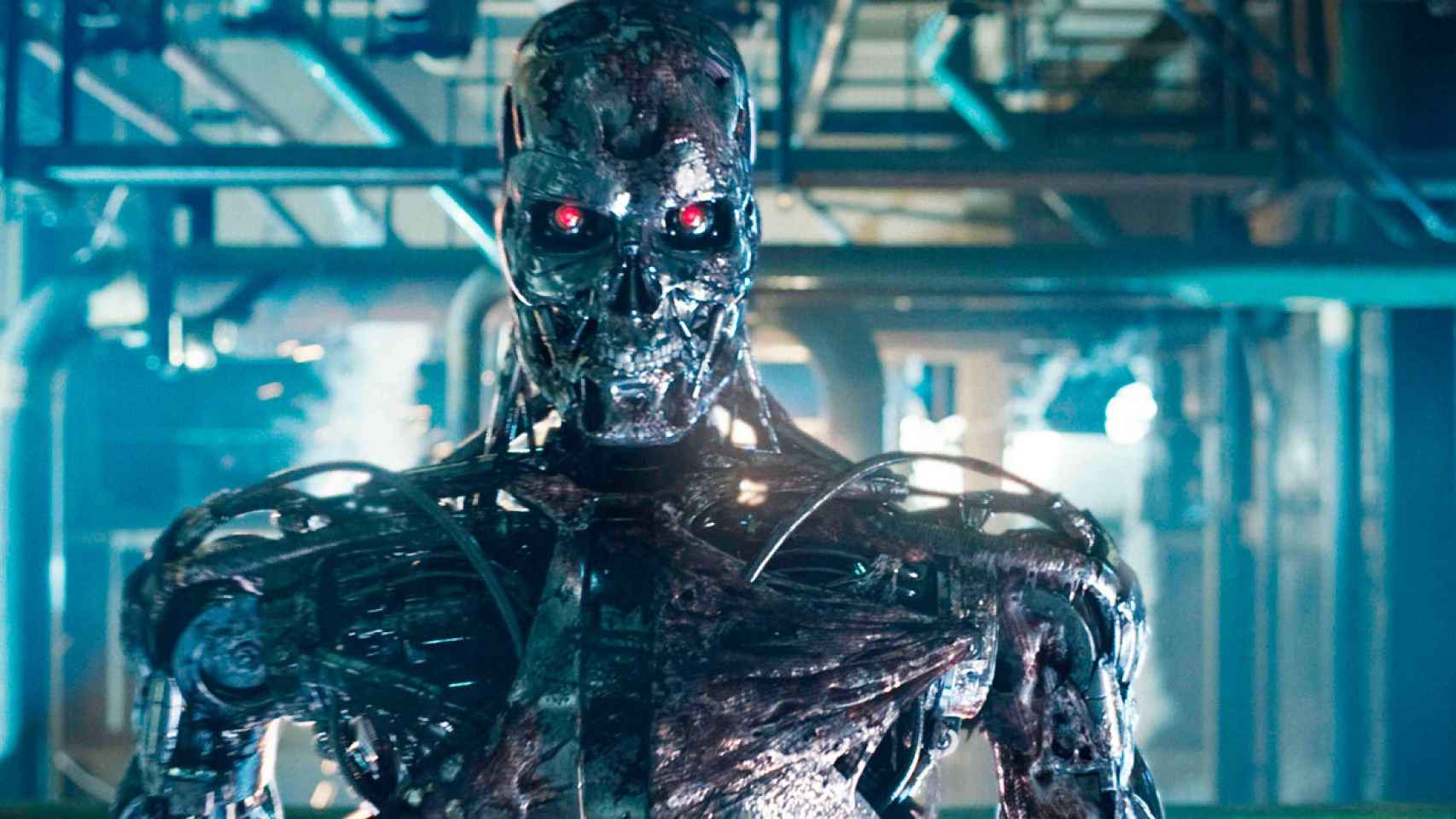

Coches autónomos que incluso fueron planteados sin volantes, drones capaces de volar sin que un humano esté pendiente de su trayectoria… y robots, muchos robots para todos los gustos, aunque todavía tengan que mejorar MUCHO para ser lo que sueñan las mentes de los investigadores. La automatización de las máquinas ya está aquí, con todos aquellos que lo apoyan y trabajan en ello, y todos aquellos detractores que se colocan en contra.

Y, como ya nos tienen acostumbrados organismos como DARPA (en EEUU), todo parece indicar que el sector militar es de los que más se aprovechan de toda esta automatización: misiles capaces de seguir su objetivo, drones pilotados a distancia… algo que, comprensiblemente, no gusta a muchos investigadores que trabajan con tecnologías autónomas.

Elon Musk, Stephen Hawking y más, en contra de IAs militares

Han sido Elon Musk y Stephen Hawking los que han encabezado una petición, firmada por cientos de expertos e investigadores en inteligencia artificial, que hace una solicitud muy concreta y específica: prohibir en todo el mundo las llamadas armas autónomas, cortar su desarrollo antes de que se conviertan en una realidad, y tengamos un problema que intentar solucionar. También han firmado personalidades como Steve Wozniak (co-fundador de Apple) y Demis Hassabis (director ejecutivo de Google DeepMind).

En esa petición alegan que, mientras con los drones hay un humano detrás, y que construir bombas nucleares en masa sólo está al alcance de pocas fuerzas militares, tener armas capaces de matar por sí solas es un auténtico peligro. Predicen que todas estas armas autónomas se convertirán en «los Kalashnikovs del mañana» si continúa su desarrollo, según podemos leer en el New York Times.

«De la misma manera que la mayoría de los químicos y biólogos no tienen interés en crear armas químicas o biológicas, la mayoría de los investigadores de IA no tienen interés en crear armas basadas en IA — y no quieren que otros lo hagan y empañen su campo”

Robots en el ejército, más cerca de lo que pensamos

Esta petición está basada en el potencial que se está abriendo en el campo de la Inteligencia Artificial: las IAs están cada vez más cerca, y esto podría abrir posibilidades en muchísimos campos. Medicina, aviación, construcción… probablemente se puede beneficiar cualquier campo en el que estéis pensando, o en el que estéis involucrados. Y, el apartado militar tampoco es una excepción, porque ya se están haciendo avances en ese campo.

Los propios detractores del uso de IAs en el campo de batalla reconocen sus ventajas: reducirían las bajas manteniendo a los soldados humanos lejos de los tiroteos, e incluso reducirían el número de enfrentamientos en todo el mundo. El problema es que eso daría comienzo a una carrera por ser los primeros en tener armas autónomas, y nos encontraríamos con un final poco agradable a primera vista.

Una petición que importará poco a los ejércitos

Sin embargo, y como este último párrafo revela, esa carrera por construir armas autónomas daría comienzo con que sólo un jugador se anime a hacerla para arrastrar al resto: son como fichas de dominó, ninguna se va a querer quedar atrás ante un ejército rival. Puede que países como EEUU y los pertenecientes a la OTAN respetaran la prohibición, pero otros países menos amigos pasarían por completo y seguirían a lo suyo.

Además, también tenemos el hecho de que ya tenemos armas ‘semi-autónomas’, por así decirlo: misiles que siguen a su objetivo automáticamente, balas que corrigen su rumbo… es cierto que hace falta que alguien pulsara el botón, pero de ahí a que el misil o la bala se dispare, sólo hay una línea muy fina. Parecen malos tiempos para los pacifistas, por desgracia.

Vía | Omicrono

Más información | The Future of Life Institute