Uno de los mayores peligros que los expertos advirtieron referentes a la inteligencia artificial residía en la desinformación. Los deepfakes y las noticias falsas son mucho más fáciles de propagar con estas tecnologías y no son pocos los que avisaron de que se usarían en cuestiones críticas. El último dirigente en sufrir esto ha sido Joe Biden, presidente de los Estados Unidos que ha sido suplantado en una llamada falsa hecha con inteligencia artificial.

Así lo recoge NBC News, que expone cómo en redes sociales está circulando una llamada que usa un audio generado por inteligencia artificial y que imita la voz de Biden. Recordemos que actualmente se están celebrando unas elecciones primarias en Nuevo Hampshire, siendo estas las primeras elecciones primarias del país de cara a las presidenciales de noviembre.

En este audio, el supuesto Biden pide a los electores que no vayan a votar a estas primarias presidenciales, y que se guardaran sus votos para las elecciones generales de noviembre. El clip, que ya está confirmado que ha sido manipulado, pide al votante que "guarde su voto hasta las elecciones de noviembre. Necesitamos su ayuda para elegir a los demócratas de todos los niveles".

Un nuevo audio deepfake

Todo comienza con una llamada automática que se estaba realizando en el estado de Nuevo Hampshire. Numerosas personas del lugar reportaron estas llamadas, pidiendo a estos votantes que no emitieran sus votos en estas primarias. "Votar este martes sólo favorece a los republicanos en su afán por volver a elegir a Donald Trump", reza este audio.

Lo más relevante es que este audio ha sido realizado emulando la voz de Joe Biden, haciendo entender a los votantes que efectivamente el presidente de los Estados Unidos está pidiendo a los demócratas no votar en estas primarias. El mensaje termina con el número de teléfono de Kathy Sullivan, anterior dirigente del Partido Demócrata en Nuevo Hampshire.

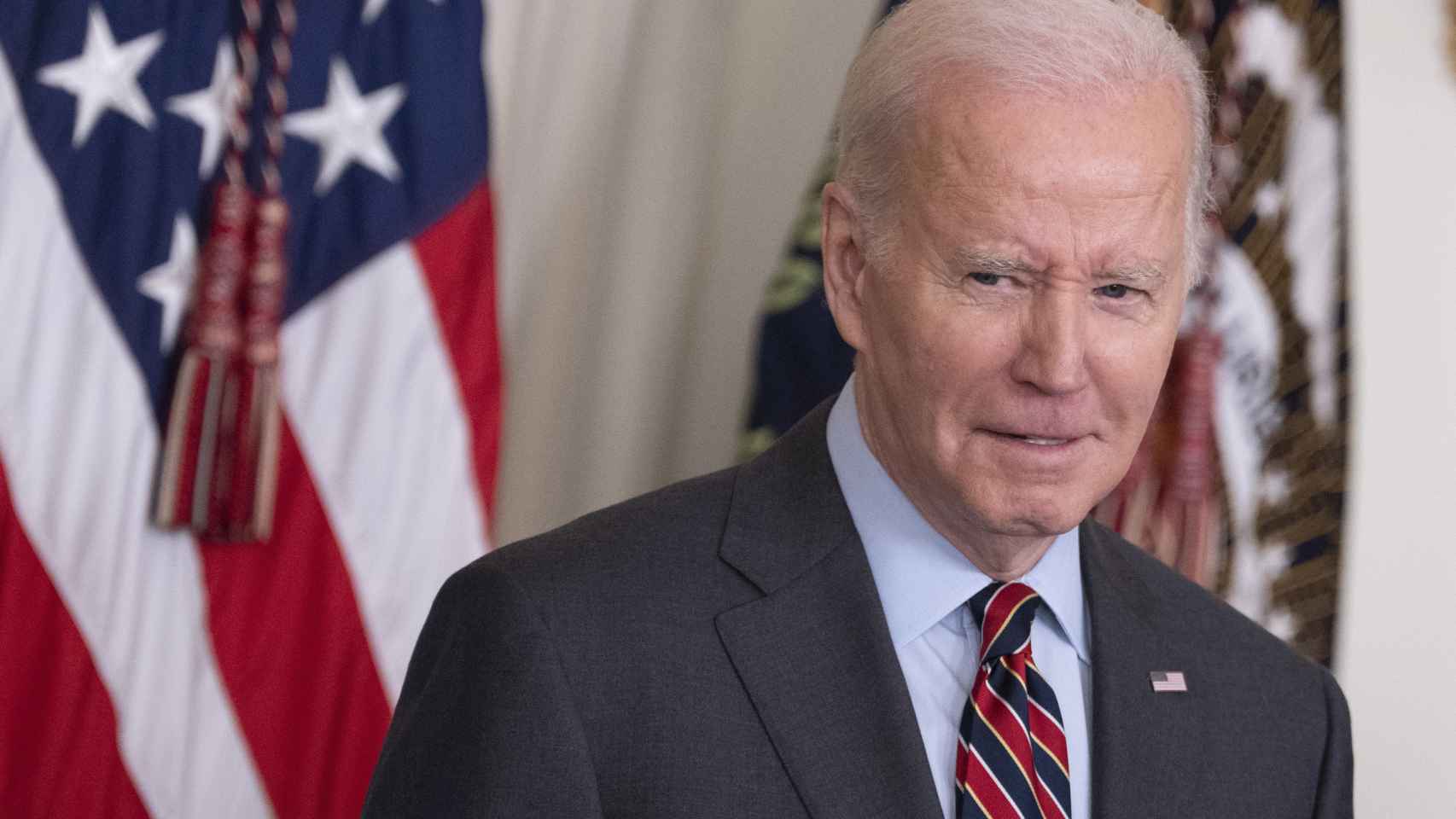

Joe Biden ante el Consejo de Asesores sobre Ciencia y Tecnología del Presidente (PCAST)

La oficina del fiscal general del estado ya ha avisado que investigarán el asunto, asegurando que este podría ser un intento de manipular las elecciones en favor de los republicanos, aunque se desconoce la identidad de los autores de este hecho. El mensaje es claro: ignorar estos mensajes y recordar que las votaciones en estas primarias no afectan en nada a las elecciones generales. Kathy Sullivan tampoco dio su permiso para el uso de su móvil personal en el audio.

La Casa Blanca se ha apresurado a confirmar que la voz del mensaje no es la de Joe Biden. Katerine Jean-Pierre, secretaria de prensa de la Casa Blanca, ha declarado a Reuters que este audio es falso y que el presidente "ha sido claro en que existen riesgos asociados con los deepfakes. Las imágenes falsas y la información errónea pueden verse exacerbadas por las tecnologías emergentes".

[El truco para detectar deepfakes: sólo hay que mirarle bien a los ojos]

Obviamente, este audio ha sido realizado con inteligencia artificial y además de emular la voz del presidente estadounidense, replica algunos de sus manierismos para dar una mayor sensación de veracidad. Por ejemplo, en el audio la voz usa una de las frases más famosas de Biden: "qué montón de tonterías" (That's a bunch of malarkey, en inglés), usada hace más de una década en un programa estadounidense contra Paul Ryan.

Por su parte, las campañas de varios dirigentes han salido a negar su colaboración en este hecho. La del expresidente Donald Trump negó que tuviera nada que ver, y actualmente no hay indicios o pruebas que relacionen al magnate con este suceso. Dean Phillips, congresista en Minnesota y único demócrata que aspira a desafiar la candidatura de Biden, también ha negado su relación, explicando que se enteró por un periodista el pasado domingo por la noche.

Deepfake de Zelensky

No es ni mucho menos la primera vez que se han usado deepfakes para cuestiones puramente políticas. Uno de los casos más flagrantes tuvo lugar en 2022, cuando en Facebook circuló un deepfake que usurpaba a Volodímir Zelenski, actual presidente de Ucrania. En él, el presidente claudicaba contra Putin, intentando desprestigiar su imagen. Facebook acabó por borrar el vídeo.

También te puede interesar...

- YouTube no quiere clones de Bad Bunny: así regulará las canciones y vídeos hechos con IA

- El vídeo falso con IA más perturbador: revive a un joven asesinado para reactivar el caso

- Así es la tecnología que ha resucitado a Lola Flores para el anuncio de Cruzcampo

- Salvador Dalí sigue vivo gracias a la inteligencia artificial y los deepfakes