No puede haber nuevo iPhone sin su respectiva polémica, y el Xs no podía ser una excepción. Lo preocupante es que en este caso afecta a uno de los aspectos más determinantes de cualquier dispositivo: la calidad de las fotografías.

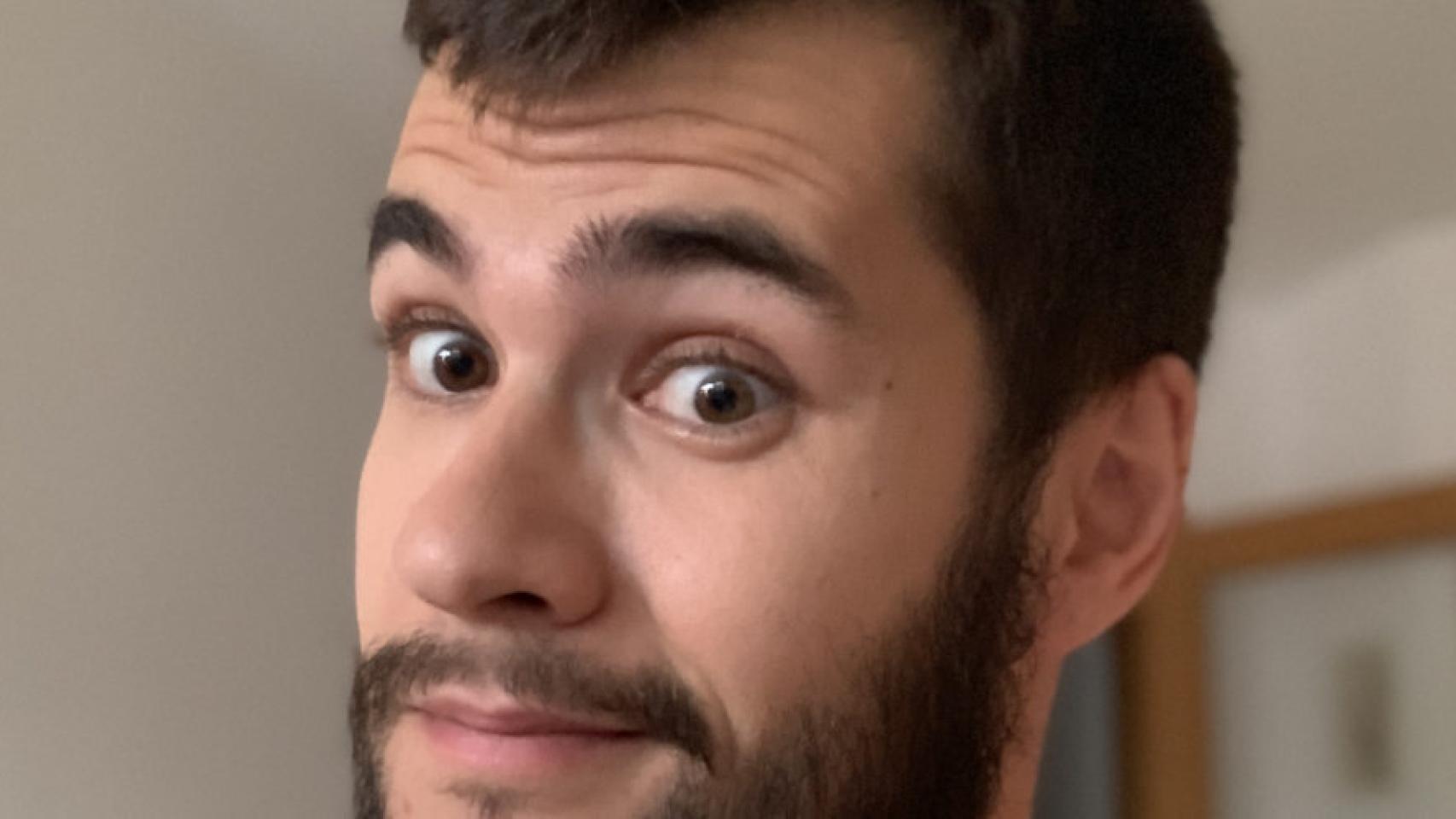

No es que el Xs ni el Xs Max hagan malas fotos, ni mucho menos; el problema por ahora se da sólo en el modo retrato, cuando nos hacemos una foto de la cara. Lo que los usuarios han dado en llamar “filtro de belleza” aplica cambios, en ocasiones muy notables; y no todo el mundo está contento.

La diferencia cuando hacemos la misma foto con un iPhone X es más que evidente. Las imperfecciones de la cara desaparecen, en algunos casos de manera flagrante. El color de la piel se vuelve más rosado, eliminando la palidez; y en general, todo tiene un aspecto más suave.

En otras palabras, se parece mucho a los “filtros de belleza” que podemos encontrar en móviles de otros fabricantes; y que son especialmente populares en países asiáticos, pero que son polémicos por el estándar de “belleza” que pretenden impulsar. La gran diferencia en este caso es que el filtro que aplican los Xs y Xs Max no se puede quitar, viene activado por defecto, y la propia Apple no reconoce que exista.

Por qué hay un filtro de belleza en el iPhone Xs

Con el paso de los días, se están aclarando algunas cosas. Para empezar, es muy probable que este no sea un filtro de belleza como tal; y que ni siquiera sea el objetivo buscado por Apple. Así lo ha planteado Sebastiaan de With, creador de Halide, una de las apps de cámara más populares de iOS.

La clave está en el software, la verdadera especialidad de Apple. Aunque los sensores de las cámaras del iPhone no son precisamente malos, sólo consiguen brillar con los algoritmos de iOS; cada año que pasa, Apple ha presentado mejoras en este sentido, nuevos algoritmos capaces de hacer más con básicamente el mismo hardware. Y con la generación del Xs, tienen la ayuda del Neural Engine del chip A12 para ejecutar complicadas operaciones.

foto iphone

Cuando hacemos una foto, en realidad estamos capturando varias imágenes sin darnos cuenta; e incluso antes de que pulsemos el botón. Los algoritmos de Apple seleccionan las mejores y las combinan para conseguir una mayor profundidad y detalles.

El problema es que esto requiere aumentar la velocidad del obturador y el valor ISO; eso se traduce en un mayor “ruido”, artefactos y grano que empeoran la imagen. Para solucionarlo, se aplican algoritmos de reducción de ruido; además, el brillo de las zonas más brillantes se baja, y se aumenta en las zonas más oscuras, creando esa sensación de imagen “suave”.

¿Un problema de hardware, o de software?

Que Apple se haya pasado con la reducción de ruido explicaría las imágenes que hemos visto. ¿Significa eso que es fácil de arreglar? Puede que sí, o puede que no. Según fuentes de AppleInsider, Apple ya está investigando este efecto en sus dispositivos.

iphone xs filtro belleza 1

Y el gran problema es que no ocurre lo mismo en todos los iPhone Xs; que en algunos dispositivos y situaciones el “filtro” es muy evidente, y en otros apenas se nota. Que dependa del dispositivo puede implicar que la reducción de ruido extrema se active sólo si la imagen no alcanza una calidad aceptable; diferencias en los sensores o en el obturador pueden ser las culpables.

Aunque todas las cámaras de los iPhone Xs están fabricadas con la mismas especificaciones, es inevitable que haya diferencias entre unidades. Esas diferencias pueden hacer imposible modificar el comportamiento de los algoritmos; pero como decimos, es muy pronto aún y Apple está investigándolo.

Noticias relacionadas

- Los podcasts originales de Apple están cerca, ¿debería temblar la competencia?

- Sony presenta la primera cámara full-frame de nada menos que 61 megapíxeles

- El nuevo MacBook Air tiene un SSD mucho más lento que el modelo anterior, ¿Apple lo ha vuelto a hacer?

- Cómo hacer que Windows 10 sea compatible con imágenes RAW con una nueva extensión