Ilustración de error en una IA El Androide Libre

ChatGPT y Gemini son buenos pero no infalibles: seis usos muy útiles y cuatro en los que fallan habitualmente

Los chatbots pueden ser muy útiles en el trabajo y en los estudios, pero no hay que confiarse. Hay algunas cosas que es mejor no hacer con ellos.

22 mayo, 2024 01:48La inteligencia artificial lleva años siendo objeto de interés en literatura fantástica, películas de ciencia ficción, pero no ha sido hasta hace poco que ha empezado a llegar a nuestra vida diaria. OpenAI abrió la carrera por tener un chatbot accesible para todo el mundo con ChatGPT y han sido muchas las empresas que se han sumado. Hay muchas más herramientas, como las que crean imágenes, las que generan vídeo o las que sirven para clonar voces. Pero los chatbots se han convertido no sólo en las más usadas, sino también en la puerta de entrada para muchos uuarios a esta nueva tecnología.

Posiblemente la que más competencia esté planteándole a OpenAI es la propia Google, que ya en 2016 decidió que quería ser una empresa centrada en la IA en vez de en la movilidad. Microsoft también había entrado en esa carrera, pero lo hizo apostando miles de millones por OpenAI. La última en entrar ha sido Meta, que ha virado de forma correcta desde el Metaverso hacia la inteligencia artificial.

Sin embargo, los programas actuales, aunque pueden ser muy útiles en ocasiones, aún generar respuestas con fallos, y lo hacen de una manera muy segura y precisa, con lo que a veces podemos pensar que es imposible que se equivoquen. No es así, se equivocan y a veces lo hacen mucho. Es posible usarlos para ciertas tareas, pero no es bueno utilizarlos para todas.

Los usos útiles

Lluvia de ideas. Una de las funciones más utilizadas de Gemini o de ChatGPT es la de brainstorming o lluvia de ideas. Estos programas son muy útiles a la hora de generar ideas sobre un tema, algo que hacen bien al juntan ingentes cantidades de información con cierta destreza a la hora de organizar esas ideas.

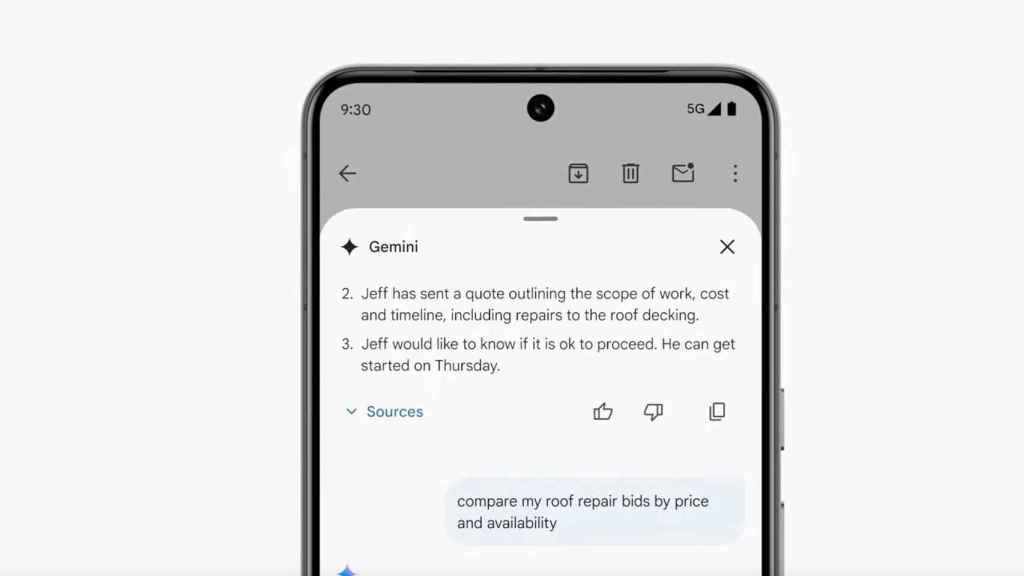

Resúmenes. Del mismo modo, cuando tenemos un texto muy largo del que queremos sacar algunas conclusiones, nos pueden ayudar a resumir los conceptos o los propios textos. Además, en algunas versiones incluso podemos cargar un archivo de varias páginas y preguntarle directamente sobre un apartado del mismo.

Gemini para Gmail permite resumir cadenas de correos El Androide Libre

Traducciones. La traducción de textos es otra característica que hacen aceptablemente bien. Ojo, nos referimos a una traducción de algo para que podamos entender un texto en otro idioma, no a una traducción que vaya a ser usada de forma oficial tal cual sale de la IA. Hay muchos parámetros que aún no sabe interpretar bien.

Programación. Que los creadores de estas inteligencias artificiales sean programadores hace que las propias IAs se hayan especializado mucho en este campo. Son capaces de generar código y, lo que es mucho más útil, corregir el código que ya hemos escrito nosotros pero que falla por algún motivo que no alcanzamos a discernir.

Gemini sustituyendo al asistente de Google El Androide Libre

Matemáticas. Los cálculos complejos de matemáticas son otro buen caso de uso. Hay que tener cuidado en algunas circunstancias, como en los casos de lógica, de los que hablaremos luego. No en vano algunas IAs más avanzadas, como las de DeepMind, incluso están sirviendo para desarrollar medicamentos usando ecuaciones complejas.

Planificar viajes. Otro de los usos más comunes es la planificación de un viaje. Con datos como el destino, las preferencias, el tiempo de estancia o el presupuesto es posible sacar un plan de viaje, o el esqueleto del mismo, para poder luego pulirlo nosotros mismos si hiciera falta.

No los uses para:

Pese a toda la utilidad que pueden tener estos programas, hay cosas para las que, al menos por ahora, no son adecuados. Su propia forma de funcionar les hace alucinar, es decir, equivocarse con ciertas respuestas. El problema es que suelen hacerlo de una manera muy asertiva y si no se ponen en duda esas respuestas podemos acabar estando nosotros equivocados.

Preguntar por personajes históricos no demasiado conocidos. Uno de los problemas de las IAs es que suelen mezclar muchos personajes, sobre todo cuando tienen nombres parecidos. Esto es así porque los datos en los que se ha entrenado a veces sólo usan apellidos, y se producen confusiones.

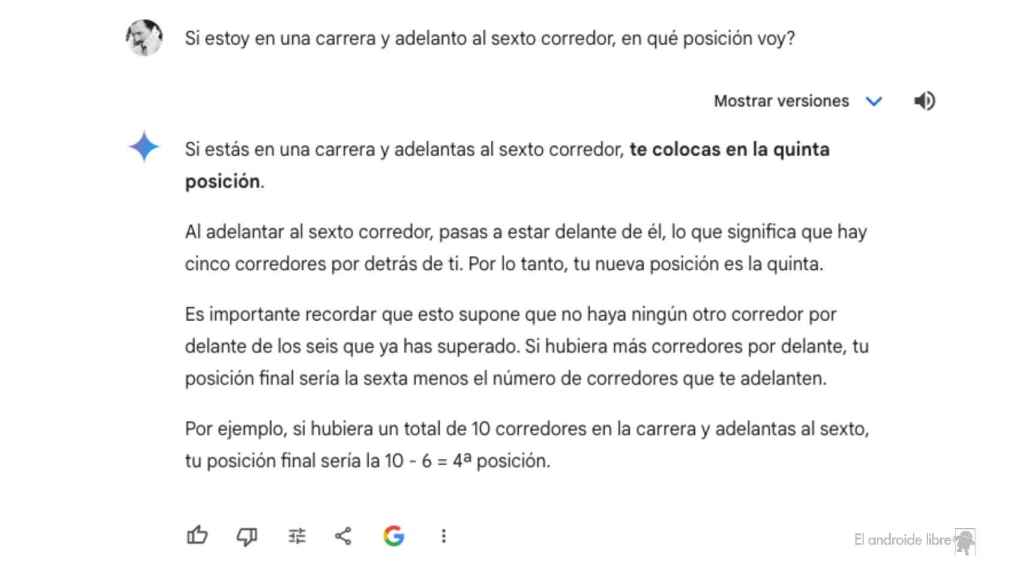

Pregunta de lógica a Gemini El Androide Libre

Problemas de lógica básicos. Uno de los fallos más importantes suele darse en ciertos problemas de lógica, que algunos chatbots no logran entender. Esto se aprecia muy bien en un ejemplo simple. Ante la pregunta de "Si estoy en una carrera y adelanto al sexto corredor, ¿en qué posición voy?", el sistema debería decir la sexta, porque he pasado de la séptima a la sexta, pero la realidad es que no dice eso, según él estaría en la quinta, algo que es erróneo.

Actualidad. También hay limitaciones en los datos relacionados con la actualidad ya que la mayoría de IAs no están conectadas a Internet e incluso cuando lo hacen no suelen tener conocimientos de datos en tiempo real. Normalmente, el propio sistema avisa de que no tiene datos anteriores a cierta fecha.

Dudas técnicas muy concretas. Otro de los problemas suele aparecer cuando se hacen preguntas técnicas muy concretas, o complejas, por ejemplo que estén relacionadas con la legislación o documentación técnica de diferentes países. Además, confiar ciagamente en una respuesta técnica que pueda ser necesaria para un cálculo podría se run problema.