Las redes sociales de Meta indicarán cuando una imagen esta creada con IA El Androide libre

Facebook, Instagram y Threads te indicarán cuando una imagen ha sido generada con IA: así piensan hacerlo

Meta ha anunciado que llegará dentro de poco el etiquetado del contenido que no ha creado por una persona para una fácil identificación.

6 febrero, 2024 15:23China fue la primera que legisló para imponer que toda imagen generada por IA lleve una marca de agua; fue justo en diciembre de 2022 cuando este tipo de contenido gráfico comenzó a convertirse en tendencia en todo el planeta. Ahora es Meta la que ha anunciado que comenzará con el etiquetado de las imágenes generadas por IA que se suban a sus redes sociales.

Diferenciar lo generado por humano de lo hecho por la IA va a ser francamente difícil si no se ponen las herramientas necesarias desde las plataformas donde más se publica este tipo de contenido. Sobre todo porque en unos años, según la evolución propia de las distintas IA para la generación de imágenes, van a ser capaces de crear imágenes totalmente hiperrealistas; aunque de momento lo pasan bastante mal con la generación de las manos.

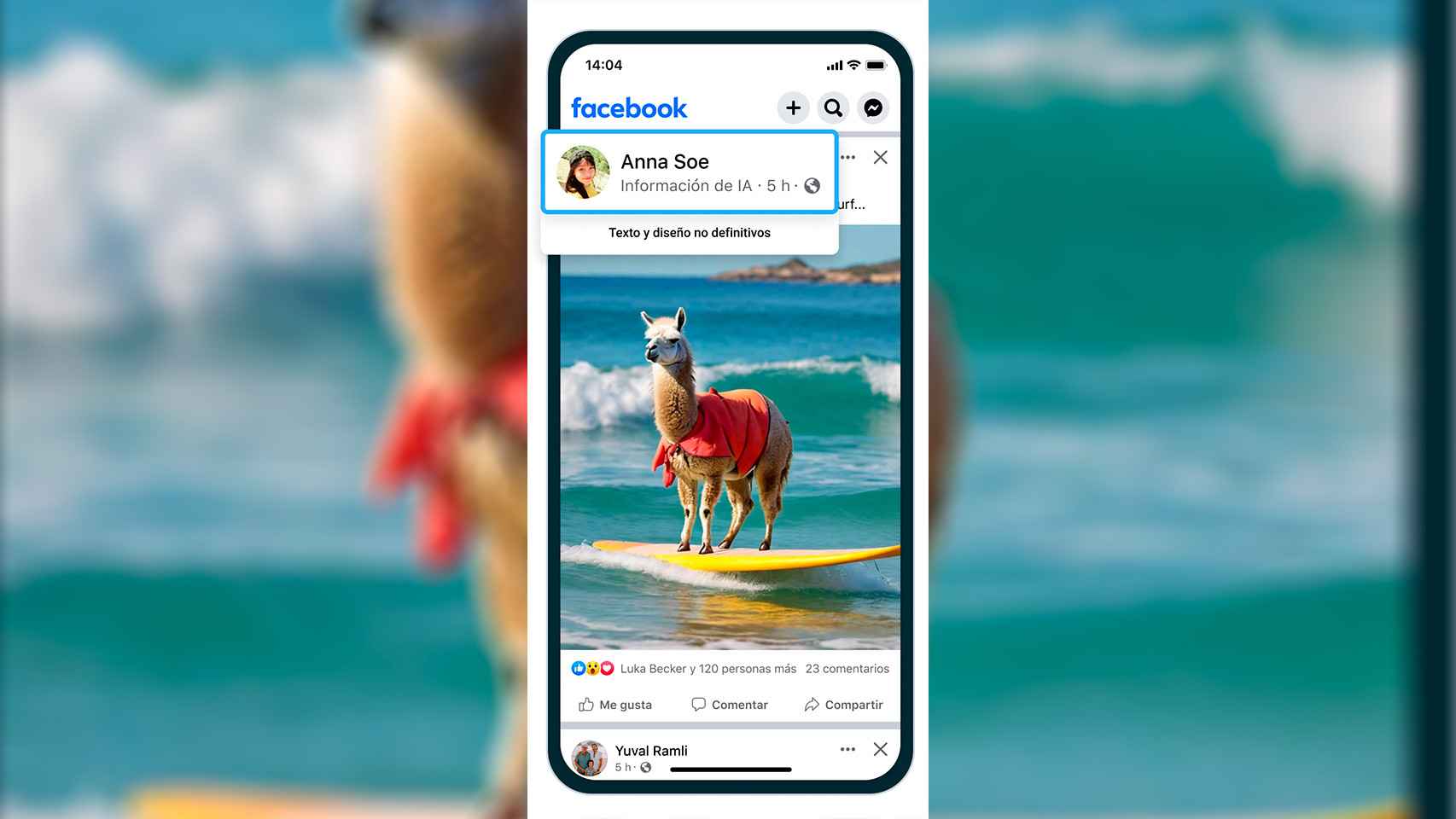

La propuesta de Meta es una de esas acciones a tomar para que al menos se sepa que el contenido que se está viendo en redes sociales está generado por alguna IA como DALL-E 3. Y es que Nick Clegg, presidente de Asuntos Globales de Meta, ha anunciado que van a comenzar a etiquetar las imágenes generadas por inteligencia artificial que los usuarios suban en Facebook, Instagram y Threads.

Ejemplo del etiquetado de imagen generada con IA en Facebook El Androide libre

Eso sí, habrá que tener un poco de paciencia, ya que el desarrollo del etiquetado de este contenido comenzará en los próximos meses. El objetivo de Meta es garantizar que los usuarios sepan si una imagen ha sido creada por una inteligencia artificial.

Ahora bien, será fácil saber si un contenido ha sido creado de esta manera, ya que se aplicará la etiqueta 'Imagined with AI' a las imágenes creadas desde Meta AI, su propia herramienta de generación. La idea es que también se puede hacer con los contenidos creados con otras herramientas de otras empresas. De hecho, la compañía ha indicado las acciones a tomar para que los usuarios sepan que la inteligencia artificial ha creado una imagen:

- Colocación de marcadores visibles que se pueden ver mismamente en las imágenes.

- Marcas de agua invisibles y metadatos incrustados dentro de los archivos de la imagen.

En lo relacionado con la identificación de contenido creado con otras herramientas, se podrá identificar el creado por Google, OpenAI, Microsoft, Adobe, Midjourney y Shutterstock; según estos mismos van desarrollando sus planes para añadir metadatos y etiquetas invisibles a las imágenes.

De momento, el etiquetado será para las imágenes, pero sí que Meta ya está trabajando con varios socios del sector como Partnership on AI (PAI) en el desarrollo de normas técnicas comunes para la identificación de otro tipo de contenido bien importante: los vídeos y audios. Sobre todo en marcadores invisibles que permitan identificar este tipo de contenido.

Otro de los desarrollos, mostrados desde el anuncio en el blog de Meta, tiene que ver con los clasificadores que ayudarán a detectar este tipo de contenido, incluso si éste carece de un marcador invisible. E importante: que el compromiso para respetar las normas comunitarias y garantizar que todos los contenidos de las tres plataformas, incluso los creados por IA, se rijan por las mismas normas.

Te puede interesar

- Google te hará pagar si quieres usar su IA más potente en tu móvil: así es su plan para Bard Advanced

- Llega el primer smartphone de Samsung con Inteligencia Artificial integrada

- El cambio de Google en su IA que llegará a tu móvil: la nueva app que llega a Android